Zukunft der Videogenerierung: VidTwin entkoppelt Struktur und Dynamik

KI sauber im Unternehmen integrieren: Der 5-Schritte-Plan

Von der ersten Idee bis zur voll integrierten KI-Lösung – strukturiert, sicher und mit messbarem Erfolg

Strategie & Zieldefinition

Wir analysieren Ihre Geschäftsprozesse und identifizieren konkrete Use Cases mit dem höchsten ROI-Potenzial.

✓ Messbare KPIs definiert

Daten & DSGVO-Compliance

Vollständige Datenschutz-Analyse und Implementierung sicherer Datenverarbeitungsprozesse nach EU-Standards.

✓ 100% DSGVO-konform

Technologie- & Tool-Auswahl

Maßgeschneiderte Auswahl der optimalen KI-Lösung – von Azure OpenAI bis zu Open-Source-Alternativen.

✓ Beste Lösung für Ihren Fall

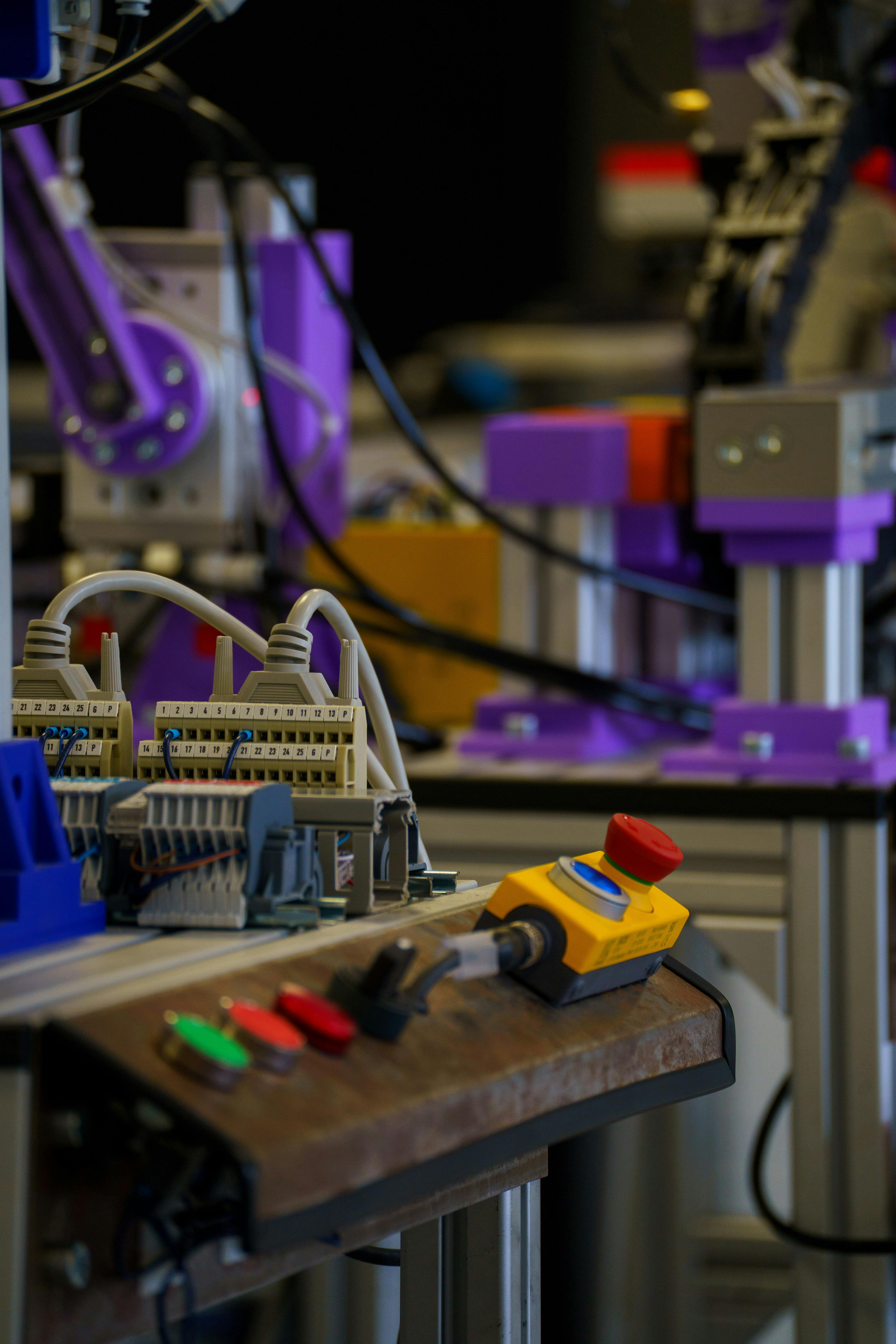

Pilotprojekt & Integration

Schneller Proof of Concept mit nahtloser Integration in Ihre bestehende IT-Infrastruktur und Workflows.

✓ Ergebnisse in 4-6 Wochen

Skalierung & Team-Schulung

Unternehmensweiter Rollout mit umfassenden Schulungen für maximale Akzeptanz und Produktivität.

✓ Ihr Team wird KI-fit

Inhaltsverzeichnis

Optimieren Sie Prozesse, automatisieren Sie Workflows und fördern Sie Zusammenarbeit – alles an einem Ort.

Videogenerierung der nächsten Generation: VidTwin entkoppelt Struktur und Dynamik

Die Welt der künstlichen Intelligenz (KI) entwickelt sich rasant, und insbesondere im Bereich der Videogenerierung gibt es ständig neue Fortschritte. Ein vielversprechender Ansatz ist VidTwin, ein neuartiges Video-VAE-Modell (Variational Autoencoder), das Struktur und Dynamik von Videos entkoppelt. Dieser innovative Ansatz ermöglicht eine präzisere Kontrolle über den Generierungsprozess und eröffnet neue Möglichkeiten für die Erstellung realistischer und kreativer Videoinhalte.

Die Herausforderung der Videogenerierung

Die Generierung von Videos stellt die KI vor besondere Herausforderungen. Videos sind komplexe Datenstrukturen, die sowohl räumliche Informationen (die einzelnen Bilder) als auch zeitliche Informationen (die Bewegung und Veränderung im Laufe der Zeit) enthalten. Bisherige Modelle hatten oft Schwierigkeiten, diese beiden Aspekte gleichzeitig zu erfassen und realistische Videos zu generieren. Häufig wirkten die generierten Videos verschwommen, unnatürlich oder wiesen Artefakte auf.

VidTwins innovativer Ansatz

VidTwin adressiert diese Herausforderungen durch die Entkopplung von Struktur und Dynamik. Das Modell besteht aus zwei separaten, aber miteinander verbundenen Komponenten: einem Struktur-Encoder und einem Dynamik-Encoder. Der Struktur-Encoder konzentriert sich auf die räumlichen Informationen und extrahiert die statischen Merkmale eines Videos, wie z.B. die Form und Textur von Objekten. Der Dynamik-Encoder hingegen analysiert die zeitlichen Informationen und erfasst die Bewegungsmuster und Veränderungen im Video.

Diese Trennung ermöglicht es VidTwin, die beiden Aspekte unabhängig voneinander zu lernen und zu modellieren. Dadurch kann das Modell die Komplexität von Videos besser erfassen und realistischere Ergebnisse erzielen. Die entkoppelte Darstellung ermöglicht zudem eine feinere Kontrolle über den Generierungsprozess. So können beispielsweise die Struktur und die Dynamik eines Videos separat manipuliert werden, um neue und kreative Videoinhalte zu erstellen.

Anwendungsbereiche von VidTwin

Die Technologie hinter VidTwin hat das Potenzial, zahlreiche Anwendungsbereiche zu revolutionieren. Von der automatisierten Erstellung von Marketingvideos über die Generierung von Trainingsdaten für KI-Systeme bis hin zur Entwicklung neuer Formen der Unterhaltung – die Möglichkeiten sind vielfältig.

Denkbar sind beispielsweise Anwendungen in folgenden Bereichen:

- Film- und Fernsehproduktion: Erstellung von Spezialeffekten und Animationen. - Videospiele: Generierung von realistischen Charakteren und Umgebungen. - Virtuelle Realität: Erstellung von immersiven Erlebnissen. - Medizin: Simulation von chirurgischen Eingriffen. - Bildung: Erstellung von interaktiven Lernmaterialien.Zukunftsaussichten

VidTwin ist ein vielversprechender Schritt in Richtung einer realistischen und effizienten Videogenerierung. Die Entkopplung von Struktur und Dynamik eröffnet neue Möglichkeiten für die Erstellung von Videoinhalten und könnte die Art und Weise, wie wir Videos produzieren und konsumieren, grundlegend verändern. Weitere Forschung und Entwicklung in diesem Bereich sind notwendig, um das volle Potenzial dieser Technologie auszuschöpfen. Es bleibt spannend zu beobachten, welche Innovationen die Zukunft der Videogenerierung bereithält.

Potenzielle Vorteile der Entkopplung

Die Entkopplung von Struktur und Dynamik in VidTwin bietet mehrere potenzielle Vorteile:

Verbesserte Generierungsqualität: Durch die separate Modellierung von Struktur und Dynamik können realistischere und detailliertere Videos generiert werden.

Feinere Kontrolle: Die Entkopplung ermöglicht eine präzisere Steuerung des Generierungsprozesses und erlaubt die Manipulation von Struktur und Dynamik unabhängig voneinander.

Effizienzsteigerung: Die separate Verarbeitung von Struktur und Dynamik kann die Effizienz des Generierungsprozesses verbessern.

Bibliographie: https://arxiv.org/abs/2412.17726 https://www.researchgate.net/publication/387351140_VidTwin_Video_VAE_with_Decoupled_Structure_and_Dynamics https://arxiv.org/html/2412.17726 https://paperreading.club/page?id=274778 https://www.zhuanzhi.ai/paper/93c21367bdcb749b0d3feffe93e9e1c4 https://www.researchgate.net/publication/259400035_Auto-Encoding_Variational_Bayes https://www.reddit.com/r/ninjasaid13/comments/1hl739b/241217726_vidtwin_video_vae_with_decoupled/ https://www.chatpaper.com/chatpaper/de?id=4&date=1734969600&page=1 https://www.zhuanzhi.ai/paper/05b7121e64d15acb8487f574070d356f

.svg)

.png)