Innovative 3D-Chip-Technologie zur Überwindung der Memory Wall in der KI-Entwicklung

KI sauber im Unternehmen integrieren: Der 5-Schritte-Plan

Von der ersten Idee bis zur voll integrierten KI-Lösung – strukturiert, sicher und mit messbarem Erfolg

Strategie & Zieldefinition

Wir analysieren Ihre Geschäftsprozesse und identifizieren konkrete Use Cases mit dem höchsten ROI-Potenzial.

✓ Messbare KPIs definiert

Daten & DSGVO-Compliance

Vollständige Datenschutz-Analyse und Implementierung sicherer Datenverarbeitungsprozesse nach EU-Standards.

✓ 100% DSGVO-konform

Technologie- & Tool-Auswahl

Maßgeschneiderte Auswahl der optimalen KI-Lösung – von Azure OpenAI bis zu Open-Source-Alternativen.

✓ Beste Lösung für Ihren Fall

Pilotprojekt & Integration

Schneller Proof of Concept mit nahtloser Integration in Ihre bestehende IT-Infrastruktur und Workflows.

✓ Ergebnisse in 4-6 Wochen

Skalierung & Team-Schulung

Unternehmensweiter Rollout mit umfassenden Schulungen für maximale Akzeptanz und Produktivität.

✓ Ihr Team wird KI-fit

Inhaltsverzeichnis

Optimieren Sie Prozesse, automatisieren Sie Workflows und fördern Sie Zusammenarbeit – alles an einem Ort.

Das Wichtigste in Kürze

- US-Forscher haben einen neuartigen 3D-Chip entwickelt, der die "Memory Wall" überwinden soll.

- Die "Memory Wall" beschreibt das Problem, dass der Datenaustausch zwischen Prozessor und Speicher zu langsam ist und die KI-Entwicklung bremst.

- Der 3D-Chip integriert Speicher und Recheneinheiten vertikal, was einen schnelleren Datenfluss ermöglicht.

- Erste Tests zeigen eine vierfache Leistungssteigerung im Vergleich zu herkömmlichen 2D-Chips.

- Langfristig wird eine Beschleunigung der KI-Hardware um den Faktor 100 bis 1.000 erwartet.

- Die Technologie könnte den Energieverbrauch und die Kosten für das Training von KI-Systemen erheblich reduzieren.

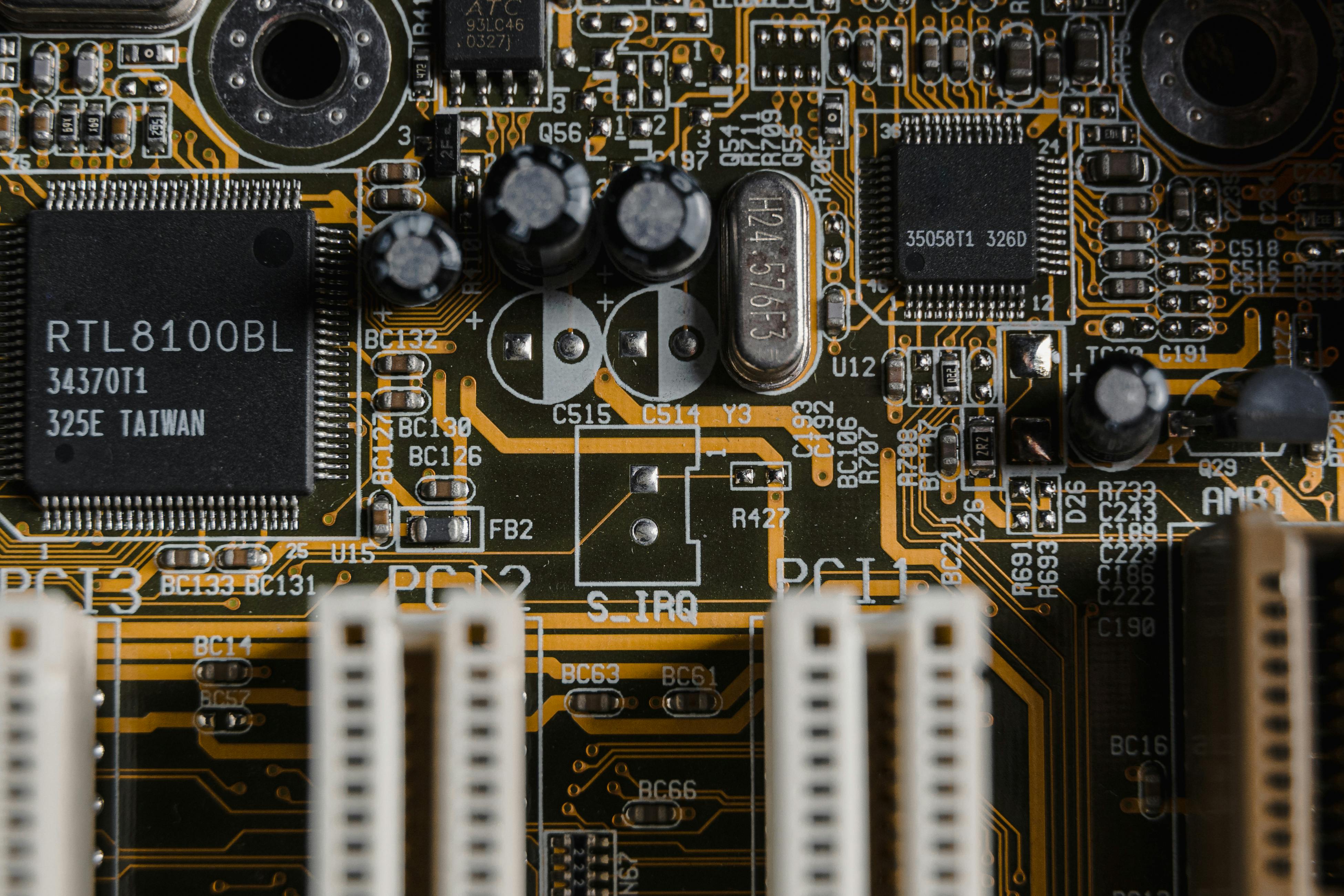

Die fortschreitende Entwicklung im Bereich der Künstlichen Intelligenz (KI) stößt zunehmend an physikalische Grenzen, insbesondere an die sogenannte „Memory Wall“. Dieses Phänomen beschreibt die Diskrepanz zwischen der immer schnelleren Rechenleistung von Prozessoren und der vergleichsweise langsamen Geschwindigkeit, mit der Daten vom Speicher zu diesen Prozessoren transportiert werden können. Diese „Memory Wall“ stellt eine erhebliche Bremse für die Effizienz und Skalierbarkeit moderner KI-Systeme dar und führt zu einem überproportionalen Anstieg des Energieverbrauchs sowie der Betriebskosten. Aktuelle Forschungsergebnisse aus den USA könnten hier jedoch einen entscheidenden Durchbruch bedeuten.

Ein neuartiger 3D-Chip als Lösungsansatz

Ein Konsortium von Forscherteams mehrerer US-Universitäten hat in Zusammenarbeit mit dem Chiphersteller Skywater Technology einen innovativen 3D-Chip entwickelt, der das Potenzial hat, die Limitationen der „Memory Wall“ zu überwinden. Dieser neue Ansatz unterscheidet sich grundlegend von herkömmlichen 2D-Chip-Architekturen, bei denen alle Komponenten auf einer einzigen, flachen Oberfläche angeordnet sind. Bei 2D-Chips sind die Speicherbereiche oft räumlich von den Recheneinheiten getrennt, was lange Datenwege und Engpässe im Datenfluss zur Folge hat.

Die Architektur des 3D-Chips

Der entwickelte 3D-Chip integriert Speicher- und Recheneinheiten vertikal übereinander. Diese Stapelbauweise ermöglicht es, Daten viel schneller und effizienter zwischen den Komponenten zu bewegen. Subhasish Mitra, Professor für Elektrotechnik und Informatik an der Stanford University und Hauptautor der zugrundeliegenden Studie, betont die Bedeutung dieser Entwicklung: „Durchbrüche wie dieser sind der Weg, um die 1.000-fachen Performance-Steigerungen bei der Hardware zu bekommen, die zukünftige KI-Systeme verlangen werden.“

Die Forscher vergleichen das Design des 3D-Chips mit der Struktur eines Hochhauses, in dem Aufzüge den schnellen Transport zwischen den Etagen (Speicher- und Rechenschichten) gewährleisten. Dieses „Manhattan der Informatik“ genannte Konzept soll einen realistischen Pfad zu einer signifikanten Verbesserung der Hardware-Performance um den Faktor 100 bis 1.000 eröffnen.

Auswirkungen auf die KI-Branche

Die „Memory Wall“ verursacht in der KI-Branche erhebliche Kosten. Schätzungen zufolge gibt beispielsweise OpenAI einen beträchtlichen Teil seines KI-Trainingsbudgets für die Ineffizienzen aus, die durch langsame Datenübertragungen entstehen. Bei Google sollen sich diese zusätzlichen Kosten auf jährlich rund zwei Milliarden US-Dollar belaufen. Eine Lösung für dieses Problem wird daher dringend gesucht.

Die vertikale Integration von Speicher und Recheneinheiten im 3D-Chip ermöglicht eine drastische Reduzierung der Datenwege. Dies führt nicht nur zu einer Beschleunigung der Verarbeitung, sondern auch zu einer Reduzierung des Energieverbrauchs und der Trainingszeiten für KI-Modelle. Die damit einhergehende Kostenersparnis könnte die Entwicklung und den Einsatz von KI-Technologien maßgeblich vorantreiben.

Aktueller Stand und zukünftige Potenziale

Erste Hardwaretests des neuen 3D-Chips haben bereits eine vierfache Leistungssteigerung im Vergleich zu herkömmlichen 2D-Chips gezeigt. Dies ist ein vielversprechender Anfang, wenngleich die angestrebten 100- bis 1.000-fachen Verbesserungen noch in der Ferne liegen. Die Forscher planen, in Zukunft noch mehr Speicher- und Rechenschichten übereinander zu stapeln und diese mit einer größeren Anzahl vertikaler Verbindungen zu versehen. Hochrechnungen deuten darauf hin, dass diese Weiterentwicklungen bereits jetzt eine bis zu zwölffache Verbesserung bei realen KI-Workloads erzielen könnten.

Der Weg zur vollständigen Ausschöpfung des Potenzials von 3D-Chips ist noch lang und birgt technische Herausforderungen, insbesondere im Bereich der Kühlung. Mit zunehmender Packungsdichte und Integrationsgrad steigt auch die Wärmeentwicklung, die effizient abgeführt werden muss. Dennoch markiert die Entwicklung dieses 3D-Chips einen wichtigen Schritt in Richtung leistungsfähigerer und energieeffizienterer KI-Hardware, die für die nächste Generation von KI-Anwendungen unerlässlich sein wird.

Bibliography: - Brien, Jörn. „„Memory Wall“ durchbrochen: Dieser 3D-Chip soll KI um den Faktor 1.000 beschleunigen“. t3n.de, 2. Januar 2026. - La Rocco, Nicolas. „Cerebras CS-3 mit WSE-3: AI-Beschleuniger in Wafergröße hat 4 Billionen Transistoren“. ComputerBase, 13. März 2024. - Spille, Carsten. „Stapelspeicher mit 36 GByte pro Chip: HBM4-Massenproduktion ab Oktober 2025“. heise online, 29. Mai 2025. - Windeck, Christof. „15.000 Watt: Stromdurst von KI-Beschleuniger steigt weiter rasant“. heise online, 16. Juni 2025. - t3n.de. „Newsticker von t3n: Die wichtigsten Tech- und Digital-News auf einen Blick“. t3n.de. - threads.com/@t3n_magazin. „t3n Magazin“. threads.com. - nachrichtenfilter.de/tech. „Technologie und IT Nachrichten - NachrichtenFilter“. nachrichtenfilter.de.

.svg)

.png)