Neue Ansätze zur Bewertung von Sprachmodellen: BERT-as-a-Judge im Fokus

KI sauber im Unternehmen integrieren: Der 5-Schritte-Plan

Von der ersten Idee bis zur voll integrierten KI-Lösung – strukturiert, sicher und mit messbarem Erfolg

Strategie & Zieldefinition

Wir analysieren Ihre Geschäftsprozesse und identifizieren konkrete Use Cases mit dem höchsten ROI-Potenzial.

✓ Messbare KPIs definiert

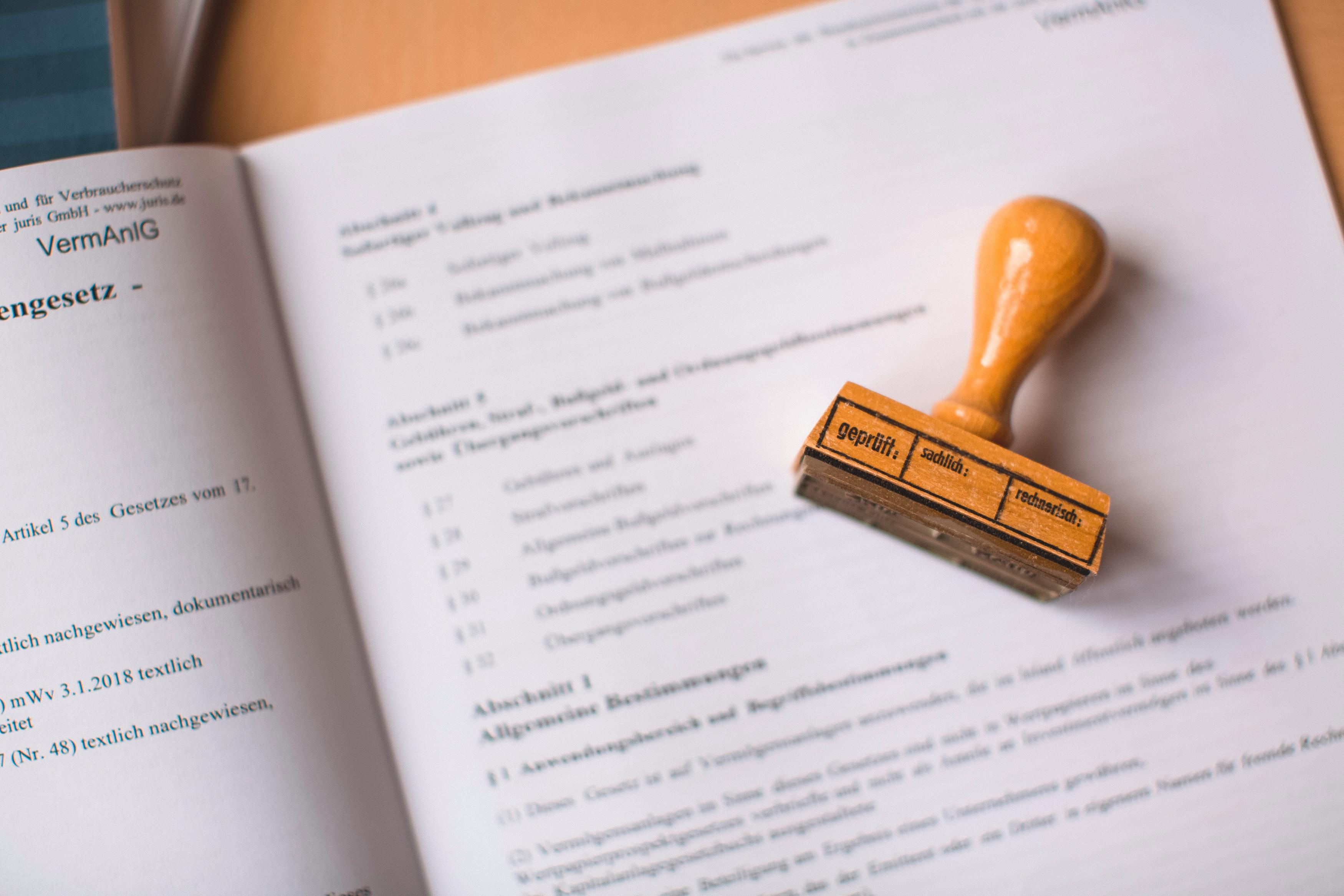

Daten & DSGVO-Compliance

Vollständige Datenschutz-Analyse und Implementierung sicherer Datenverarbeitungsprozesse nach EU-Standards.

✓ 100% DSGVO-konform

Technologie- & Tool-Auswahl

Maßgeschneiderte Auswahl der optimalen KI-Lösung – von Azure OpenAI bis zu Open-Source-Alternativen.

✓ Beste Lösung für Ihren Fall

Pilotprojekt & Integration

Schneller Proof of Concept mit nahtloser Integration in Ihre bestehende IT-Infrastruktur und Workflows.

✓ Ergebnisse in 4-6 Wochen

Skalierung & Team-Schulung

Unternehmensweiter Rollout mit umfassenden Schulungen für maximale Akzeptanz und Produktivität.

✓ Ihr Team wird KI-fit

Inhaltsverzeichnis

Optimieren Sie Prozesse, automatisieren Sie Workflows und fördern Sie Zusammenarbeit – alles an einem Ort.

Das Wichtigste in Kürze

- Herkömmliche lexikalische Bewertungsmethoden für Large Language Models (LLMs) korrelieren oft schlecht mit menschlichen Urteilen und können die tatsächliche Problemlösungsfähigkeit mit Formatierungskonformität verwechseln.

- BERT-as-a-Judge bietet eine robuste, effiziente und semantisch korrekte Alternative zu diesen Methoden, indem es einen Encoder-basierten Ansatz verwendet.

- Der neue Ansatz ist widerstandsfähig gegenüber Variationen in der Ausformulierung von Antworten und erfordert nur ein leichtgewichtiges Training auf synthetisch annotierten Tripeln (Frage-Kandidat-Referenz).

- Experimente zeigen, dass BERT-as-a-Judge konsistent bessere Ergebnisse erzielt als lexikalische Baselines und die Leistung wesentlich größerer LLM-Juroren erreicht, jedoch mit deutlich geringerem Rechenaufwand.

- Die Methode zeigt eine starke Generalisierungsfähigkeit über verschiedene Aufgaben und bisher ungesehene Modelle hinweg und ermöglicht eine zuverlässige und skalierbare Bewertung.

Revolutionäre Bewertung von Sprachmodellen: BERT-as-a-Judge als robuster Standard

Die präzise und zuverlässige Bewertung von Large Language Models (LLMs) ist ein fundamentaler Pfeiler für deren Weiterentwicklung und erfolgreiche Implementierung in vielfältigen Anwendungsfällen. Traditionelle Bewertungsansätze stützen sich jedoch häufig auf starre lexikalische Methoden, die generative Ausgaben primär auf ihre strikte Einhaltung vordefinierter Formatierungsrichtlinien hin überprüfen. Diese Vorgehensweise birgt das Risiko, die eigentliche Problemlösungsfähigkeit eines Modells mit seiner bloßen Formatierungskonformität zu verwechseln, was zu fehlerhaften Leistungseinschätzungen führen kann.

Grenzen der lexikalischen Evaluation

Eine umfassende empirische Studie, die 36 Modelle über 15 nachgelagerte Aufgaben hinweg untersuchte, hat die Limitationen lexikalischer Bewertungsmethoden systematisch aufgezeigt. Die Ergebnisse belegen, dass diese Ansätze oft nur eine geringe Korrelation mit menschlichen Urteilen aufweisen. Dies deutet darauf hin, dass eine Bewertung, die sich zu stark auf oberflächliche Struktur und Wortübereinstimmung konzentriert, die semantische Korrektheit und die tatsächliche Leistungsfähigkeit eines Modells unzureichend erfasst. Solche Diskrepanzen können dazu führen, dass Modelle, die inhaltlich korrekte, aber stilistisch unkonventionelle Antworten liefern, ungerechtfertigt schlechter bewertet werden.

LLM-as-a-Judge: Ein vielversprechender, aber kostenintensiver Ansatz

Als Reaktion auf diese Herausforderungen haben sich in jüngster Zeit sogenannte "LLM-as-a-Judge"-Frameworks etabliert. Diese Ansätze delegieren die Bewertungsaufgabe an ein separates Sprachmodell, das die semantische Korrektheit der generierten Antworten beurteilt, anstatt sich an strikte Formatierungsvorgaben zu klammern. Obwohl diese Methode eine nuanciertere und flexiblere Bewertung ermöglicht, ist sie mit einem erheblichen Rechenaufwand verbunden. Dies führt zu hohen Kosten und macht eine breite und skalierbare Anwendung in der Praxis oft unrentabel.

Die Einführung von BERT-as-a-Judge: Effizienz trifft Genauigkeit

Vor diesem Hintergrund wurde BERT-as-a-Judge als eine innovative Lösung entwickelt, die die Vorteile semantischer Bewertung mit operativer Effizienz verbindet. Dieser Encoder-basierte Ansatz, der auf der Architektur von BERT aufbaut, ist speziell dafür konzipiert, die Korrektheit von Antworten in referenzbasierten generativen Szenarien zu beurteilen. Seine Robustheit gegenüber Variationen in der Ausformulierung der Ausgaben ist ein entscheidender Vorteil, da sie sicherstellt, dass die Bewertung nicht durch stilistische Unterschiede verzerrt wird. Der Trainingsaufwand für BERT-as-a-Judge ist dabei vergleichsweise gering, da er nur ein leichtgewichtiges Training auf synthetisch annotierten Tripeln (Frage-Kandidat-Referenz) erfordert.

Empirische Validierung und praktische Implikationen

Umfassende Experimente belegen, dass BERT-as-a-Judge die lexikalische Baseline konsistent übertrifft. Gleichzeitig erreicht es die Leistungsfähigkeit von wesentlich größeren LLM-Juroren, die mit einem weitaus höheren Rechenaufwand verbunden sind. Dies stellt einen überzeugenden Kompromiss dar, der eine zuverlässige, skalierbare und kosteneffiziente Bewertung von LLMs ermöglicht. Die Generalisierungsfähigkeit des Ansatzes wurde ebenfalls nachgewiesen: BERT-as-a-Judge liefert auch bei Aufgaben, die nicht Teil des Trainingsdatensatzes waren, sowie bei bisher ungesehenen Modellen präzise Ergebnisse. Diese Eigenschaften machen BERT-as-a-Judge zu einem wertvollen Werkzeug für Praktiker, die eine genaue und effiziente Bewertung von Sprachmodellen benötigen.

Ausblick und zukünftige Forschungsrichtungen

Die vorgestellte Methode adressiert eine zentrale Herausforderung im LLM-Ökosystem und trägt dazu bei, die Bewertung von Sprachmodellen objektiver und effizienter zu gestalten. Zukünftige Forschungsarbeiten könnten die Anwendbarkeit von BERT-as-a-Judge auf noch breitere Szenarien ausweiten, darunter offene Textgenerierungsaufgaben, mehrsprachige Kontexte und multimodale Inputs. Die kontinuierliche Verbesserung der Bewertungsmechanismen ist entscheidend, um den Fortschritt in der Entwicklung von KI-Modellen verantwortungsvoll und nachhaltig zu gestalten.

.svg)

.png)