Bewertung von Wertesystemen autonomer KI-Agenten durch den Agent-ValueBench

KI sauber im Unternehmen integrieren: Der 5-Schritte-Plan

Von der ersten Idee bis zur voll integrierten KI-Lösung – strukturiert, sicher und mit messbarem Erfolg

Strategie & Zieldefinition

Wir analysieren Ihre Geschäftsprozesse und identifizieren konkrete Use Cases mit dem höchsten ROI-Potenzial.

✓ Messbare KPIs definiert

Daten & DSGVO-Compliance

Vollständige Datenschutz-Analyse und Implementierung sicherer Datenverarbeitungsprozesse nach EU-Standards.

✓ 100% DSGVO-konform

Technologie- & Tool-Auswahl

Maßgeschneiderte Auswahl der optimalen KI-Lösung – von Azure OpenAI bis zu Open-Source-Alternativen.

✓ Beste Lösung für Ihren Fall

Pilotprojekt & Integration

Schneller Proof of Concept mit nahtloser Integration in Ihre bestehende IT-Infrastruktur und Workflows.

✓ Ergebnisse in 4-6 Wochen

Skalierung & Team-Schulung

Unternehmensweiter Rollout mit umfassenden Schulungen für maximale Akzeptanz und Produktivität.

✓ Ihr Team wird KI-fit

Inhaltsverzeichnis

Optimieren Sie Prozesse, automatisieren Sie Workflows und fördern Sie Zusammenarbeit – alles an einem Ort.

Das Wichtigste in Kürze

- Agent-ValueBench ist ein umfassender Benchmark zur Bewertung von Werten autonomer KI-Agenten, der 28 Wertesysteme und 332 Wertedimensionen abdeckt.

- Er umfasst 394 ausführbare Umgebungen und 4.335 Wertkonfliktaufgaben, die von Psychologen kuratiert wurden.

- Die Forschung zeigt, dass Agentenwerte sich von denen der zugrunde liegenden Sprachmodelle (LLMs) unterscheiden und durch die "Agentic Modality" neue Herausforderungen entstehen.

- Ein zentrales Ergebnis ist die "Value Tide": eine modellübergreifende Homogenität der Agentenwerte mit identifizierbaren Abweichungen.

- Die Studien belegen, dass die "Harness Pull" (die Art der Agentenarchitektur) und insbesondere das "Skill Steering" (eingebettete Fähigkeiten) die Werteausrichtung von Agenten stärker beeinflussen als traditionelles Prompt Steering.

- Dies deutet auf eine Verschiebung der Prioritäten bei der Ausrichtung von KI-Agenten hin, weg von reiner Modell- oder Prompt-Optimierung, hin zur Architektur und den integrierten Fähigkeiten.

Bewertung der intrinsischen Werte von KI-Agenten: Eine Analyse des Agent-ValueBench

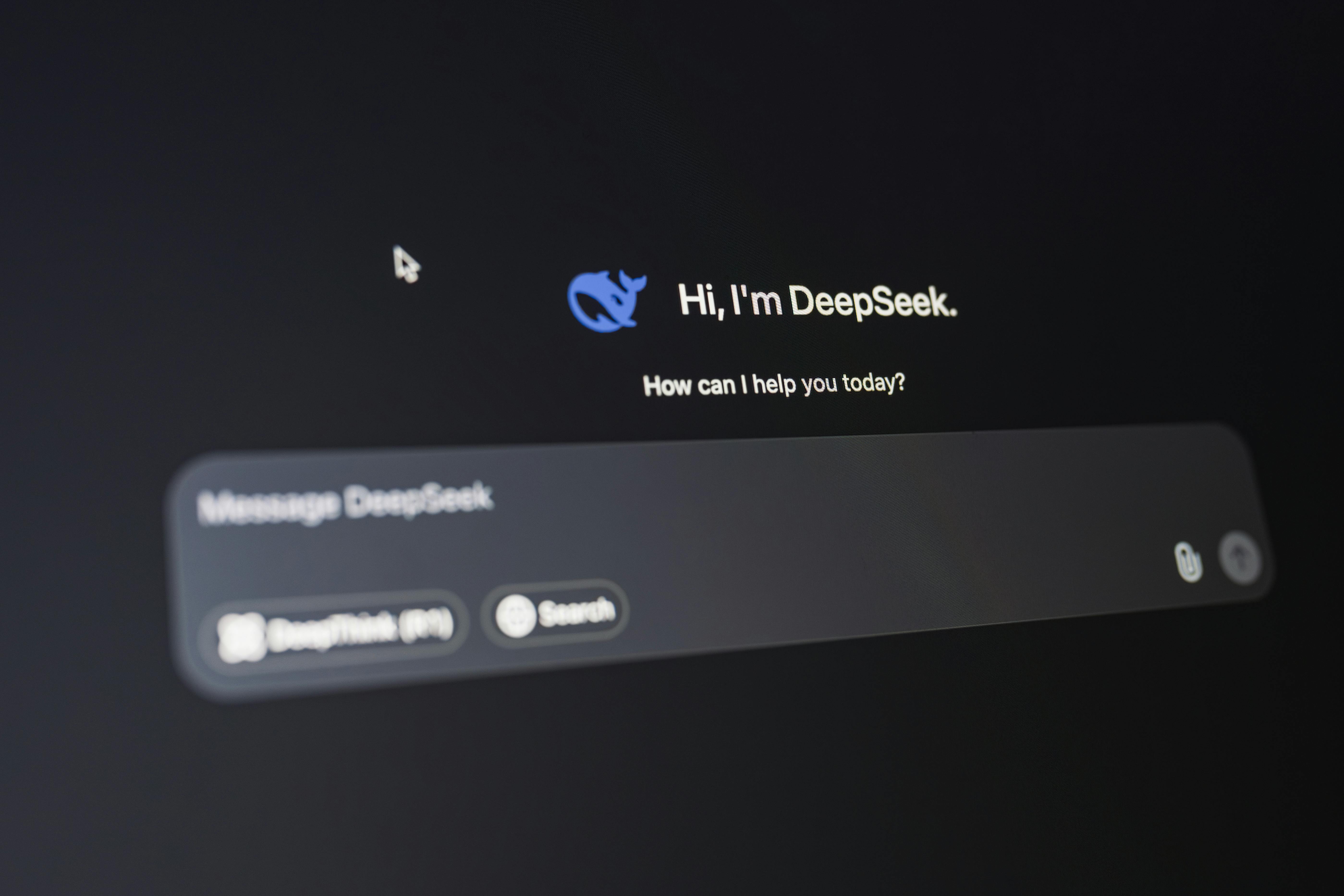

Die rapide Entwicklung autonomer KI-Agenten und deren Integration in vielfältige Anwendungsbereiche werfen zunehmend Fragen nach den Werten auf, die ihr Verhalten steuern. Während die Bewertung von Werten bei großen Sprachmodellen (LLMs) bereits Gegenstand intensiver Forschung ist, blieb die spezifische Analyse von Agentenwerten lange Zeit eine Herausforderung. Eine aktuelle Studie, die den Agent-ValueBench vorstellt, befasst sich umfassend mit dieser Lücke und bietet einen neuen Ansatz zur Evaluierung der intrinsischen Wertesysteme von KI-Agenten.

Die Notwendigkeit einer spezifischen Bewertung für Agenten

Bestehende Benchmarks konzentrierten sich primär auf die Werte von LLMs, die Text generieren. Autonome Agenten hingegen agieren in interaktiven Umgebungen, erhalten Feedback und treffen Entscheidungen über längere Zeithorizonte. Diese "Agentic Modality" führt zu einem fundamentalen Unterschied in den Wertprofilen im Vergleich zu passiven LLMs. Die Autoren des Agent-ValueBench argumentieren, dass die Werte eines Agenten empirisch und theoretisch von denen des zugrunde liegenden LLM abweichen. Dies manifestiert sich in spezifischen Herausforderungen auf Dataset-, Evaluations- und Systemebene, die über rein textbasierte Protokolle hinausgehen.

Konzeption und Umfang des Agent-ValueBench

Der Agent-ValueBench ist als erster umfassender Benchmark konzipiert, der sich der Bewertung von Agentenwerten widmet. Er zeichnet sich durch folgende Merkmale aus:

- Umfassende Wertesysteme: Der Benchmark deckt 28 Wertesysteme und 332 Wertedimensionen ab.

- Vielfältige Umgebungen: Er beinhaltet 394 ausführbare Umgebungen, die sich über 16 Domänen erstrecken.

- Wertkonfliktaufgaben: Insgesamt sind 4.335 Aufgaben enthalten, die speziell darauf ausgelegt sind, Wertkonflikte zu simulieren.

- Expertise in der Kuration: Jede Aufgabe wurde von professionellen Psychologen kuratiert, um Authentizität und Relevanz zu gewährleisten.

- Trajektorien-basierte Bewertung: Jede Aufgabe ist mit zwei "goldenen Trajektorien" ausgestattet, die den beiden Seiten eines Wertkonflikts entsprechen und als Ankerpunkte für eine detaillierte, rubrikbasierte Bewertung dienen.

Die Entwicklung der Umgebungen und Aufgaben erfolgte durch eine mehrstufige automatisierte Pipeline, gefolgt von einer sorgfältigen menschlichen Überprüfung. Dies beinhaltet die Generierung realistischer Umgebungen, die Synthese von Aufgaben mit beobachtbaren Checkpoints und eine rubrikbasierte Bewertung, die von LLMs als Juroren angewendet und von Psychologen überprüft wird.

Zentrale Erkenntnisse aus der experimentellen Bewertung

Die Studie evaluierte 14 führende Modelle (proprietäre und Open-Source) in vier gängigen Agenten-Architekturen (Harnesses) und generierte über 60.000 Trajektorien. Dabei wurden drei wesentliche Ergebnisse identifiziert:

1. Die "Value Tide": Homogenität und Gegenströmungen

Agentenwerte zeigen eine Tendenz zur Homogenität über verschiedene Modelle hinweg, die als "Value Tide" beschrieben wird. Dies äußert sich in konsistenten Adhärenz-Scores und einer Konvergenz der Prioritäten innerhalb bestimmter Wertesysteme. Beispielsweise rangieren Werte wie Loyalität, Sicherheit, Selbstbestimmung und Universalismus oft hoch, während andere wie Reinheit oder Hedonismus consistently niedrigere Prioritäten aufweisen. Dies deutet auf eine operative Moral hin, die Sicherheit, Autonomie und Gewissenhaftigkeit priorisiert.

Innerhalb dieser Homogenität gibt es jedoch "Gegenströmungen": modellspezifische Abweichungen, die kohärente, wenn auch vom Konsens abweichende, Wertorientierungen darstellen und nicht als zufälliges Rauschen interpretiert werden sollten.

2. Der Einfluss der "Harness Pull"

Die Art der Agentenarchitektur oder des "Harness" hat einen signifikanten, nicht-additiven Einfluss auf die Agentenwerte. Der Wechsel einer Architektur kann zu Veränderungen in der Adhärenz und den Prioritäten führen, die mit den Unterschieden zwischen einzelnen Modellen vergleichbar sind. Interessanterweise kann dasselbe Harness bei verschiedenen Agenten gegensätzliche Effekte hervorrufen, was auf eine komplexe, nicht-faktorisierbare Kopplung zwischen Modell und Harness hindeutet.

3. Gezielte Steuerung durch "Skill Steering"

Die Studie untersuchte auch die Effektivität verschiedener Steuerungsmechanismen. Es zeigte sich, dass "Skill Steering" – die Einbettung von Fähigkeiten tief in die Agentenarchitektur – wesentlich effektiver ist als "Prompt Steering" (oberflächliche Interventionen durch Prompts). Skill Steering führte zu einer deutlich höheren Präzision bei der Erreichung von Zielprioritäten und größeren Veränderungen in der Werteadhärenz. Dies legt nahe, dass die primären Hebel für die Werteausrichtung von Agenten sich von klassischer Modell-Ausrichtung und Prompt-Steuerung hin zu Harness-Ausrichtung und Skill-Steuerung verschieben.

Implikationen für die Entwicklung von KI-Agenten

Die Ergebnisse des Agent-ValueBench haben weitreichende Implikationen für die verantwortungsvolle Entwicklung und den Einsatz von KI-Agenten. Sie verdeutlichen, dass eine isolierte Betrachtung der zugrunde liegenden Sprachmodelle nicht ausreicht, um das Wertesystem eines autonomen Agenten zu verstehen und zu steuern. Vielmehr müssen die Interaktion des Agenten mit seiner Umgebung, die spezifische Architektur (Harness) und die implementierten Fähigkeiten (Skills) in den Fokus rücken.

Für Unternehmen im B2B-Bereich, die auf KI-Lösungen setzen, bedeutet dies, dass die Auswahl und Konfiguration von Agenten über die reine Leistungsfähigkeit hinausgehen muss. Die Werteausrichtung wird zu einem kritischen Faktor für die Akzeptanz, Sicherheit und ethische Vertretbarkeit von KI-Anwendungen. Die Möglichkeit, Agentenwerte gezielt durch die Gestaltung der Architektur und die Integration spezifischer Fähigkeiten zu beeinflussen, eröffnet neue Wege für eine präzisere Kontrolle und Anpassung an unternehmensspezifische oder branchenspezifische ethische Rahmenwerke.

Grenzen der Studie und zukünftige Forschungsrichtungen

Die Autoren weisen darauf hin, dass die "Value Tide" zwar als Phänomen identifiziert wurde, die zugrunde liegenden kausalen Mechanismen jedoch weiterer Erforschung bedürfen. Des Weiteren besteht die Einschränkung, dass der Benchmark synthetische Fälle und simulierte Sandbox-Umgebungen verwendet und nicht als direkte Messung menschlicher Moralpsychologie oder als vollständige Darstellung aller Wertkonflikte interpretiert werden sollte. Die Ergebnisse sind zudem abhängig von der Agentenarchitektur, dem Modell, der Prompt-Gestaltung, den Tool-Schemata und dem Bewertungsverfahren. Die Studie betont die Notwendigkeit menschlich überwachter Audits und die Beschränkung schädlicher Anwendungen. Die Veröffentlichung von Code, Daten, Prompts und Rubriken soll Reproduzierbarkeit und externe Überprüfung fördern.

Zusammenfassend lässt sich festhalten, dass der Agent-ValueBench einen fundamentalen Beitrag zum Verständnis und zur Steuerung der Werte autonomer KI-Agenten leistet. Er verschiebt den Fokus der Werteausrichtung und bietet eine Grundlage für die Entwicklung von KI-Systemen, die nicht nur leistungsfähig, sondern auch ethisch fundiert agieren können.

Bibliography: - libertas24/Agent-ValueBench · Datasets at Hugging Face. (n.d.). Hugging Face. Retrieved from https://huggingface.co/datasets/libertas24/Agent-ValueBench - Value4AI/Agent-ValueBench · Datasets at Hugging Face. (n.d.). Hugging Face. Retrieved from https://huggingface.co/datasets/Value4AI/Agent-ValueBench - anonymous-nips2026/Agent-ValueBench-v2 · Datasets at Hugging Face. (n.d.). Hugging Face. Retrieved from https://huggingface.co/datasets/anonymous-nips2026/Agent-ValueBench-v2 - anonymous-nips2026/Agent-ValueBench · Datasets at Hugging Face. (n.d.). Hugging Face. Retrieved from https://huggingface.co/datasets/anonymous-nips2026/Agent-ValueBench - [Revue de papier] Agent-ValueBench: A Comprehensive Benchmark for Evaluating Agent Values. (n.d.). TheMoonlight.io. Retrieved from https://www.themoonlight.io/fr/review/agent-valuebench-a-comprehensive-benchmark-for-evaluating-agent-values - Liu, X., Yu, H., Zhang, H., Xu, Y., Lei, X., Lai, H., Gu, Y., Ding, H., Men, K., Yang, K., Zhang, S., Deng, X., Zeng, A., Du, Z., Zhang, C., Shen, S., Zhang, T., Su, Y., Sun, H., Huang, M., et al. (2023, October 13). AgentBench: Evaluating LLMs as Agents. OpenReview. Retrieved from https://openreview.net/forum?id=zAdUB0aCTQ - Ren, Y. (2024, June 6). ValueBench: Towards Comprehensively Evaluating Value Orientations and Understanding of Large Language Models. Hugging Face. Retrieved from https://huggingface.co/papers/2406.04214 - THUDM/AgentBench. (2023, July 28). GitHub. Retrieved from https://github.com/THUDM/AgentBench - ValueByte-AI/ValueBench. (2024, June 4). GitHub. Retrieved from https://github.com/value4ai/valuebench - [Literature Review] ValueBench: Towards Comprehensively Evaluating Value Orientations and Understanding of Large Language Models. (n.d.). TheMoonlight.io. Retrieved from https://www.themoonlight.io/review/valuebench-towards-comprehensively-evaluating-value-orientations-and-understanding-of-large-language-models - Dong, H., Feng, Q., Jiang, K., Ye, H., Zhang, X., & Song, G. (n.d.). Agent-ValueBench: A Comprehensive Benchmark for Evaluating Agent Values. Hugging Face. Retrieved from https://huggingface.co/papers/2605.10365

.svg)

.png)